www.mundonano.unam.mx | Mundo Nano| 2(1), enero-junio, 2009

Artículos de investigación

Problemas axiológicos y éticos de la tecnociencia

León Olivé*

* Instituto de Investigaciones Filosóficas. Universidad Nacional Autónoma de México (UNAM).

Resumen:

En el siglo XX surgieron nuevos sistemas de generación de conocimiento y de intervención en la realidad cuyas estructuras de normas y valores son diferentes a las que tienen los sistemas científicos y tecnológicos tradicionales. Por su intenso impacto social, cultural, económico y ambiental, se habla de “la revolución tecnocientífica”. La nanotecnología forma parte de esta revolución. Se examina la estructura axiológica de esos sistemas, así como formas de enfrentar los problemas éticos que plantean.

Palabras clave: ntecnociencia, nanotecnología, ética y axiología.

Prácticas generadoras de conocimiento: científicas, tecnológicas y tecnocientíficas

Entre las prácticas humanas generadoras de conocimiento destacan por excelencia las científicas, cuyos resultados son conocimientos que se juzgan en primer lugar en términos de normas y valores epistémicos, pero que también pueden ser evaluados desde otros puntos de vista, por ejemplo, el estético, y muchas veces también de acuerdo con valores éticos.1 Para considerar como auténtico conocimiento a los resultados de las prácticas científicas no se requiere juzgarlos en función de valores económicos, pero es cierto que los conocimientos adquieren valor económico cuando son incorporados en otras prácticas, como las tecnológicas, para transformar objetos que luego se intercambian y adquieren valor de cambio en un mercado. Al ser usado y al aplicarse en prácticas no científicas, como las tecnológicas, el conocimiento científico puede ser evaluado en términos de valores que no son intrínsecos de las prácticas donde se genera, las científicas.

Las prácticas científicas en sentido estricto nunca han estado orientadas a la producción de resultados con un valor de mercado, y jamás han sometido sus resultados a procesos de compra-venta en mercados de conocimiento. Por el contrario, si de algo se ha preciado y sigue preciándose la ciencia moderna es del carácter público de sus resultados. Así ha sido desde sus inicios, y así sigue siendo. Esto es, los valores que dominan dentro de las prácticas científicas, en el sentido de la ciencia moderna que surgió en los siglos XVI y XVII, a diferencia de las prácticas que aparecieron en el siglo XX, llamadas tecnocientíficas, son sobre todo valores epistémicos, y no incluyen valores económicos.2

Una consecuencia de lo anterior, que podemos señalar de paso con respecto a las políticas científicas, es que la promoción del desarrollo de la ciencia, así como la evaluación del desempeño de los científicos y de sus productos, debe hacerse con base en criterios que tomen en cuenta los valores y las normas de los sistemas científicos tal y como han llegado a nuestros días a partir de su surgimiento, y como particularmente han evolucionado en el último siglo. El crecimiento de la ciencia debe promoverse con base en sus propios valores, especialmente los epistémicos, y no debe confundirse con una orientación hacia la mal llamada “ciencia aplicada”. Sin ciencia, a secas, no hay posibilidad de auténtica innovación. Otra cuestión, como veremos adelante, es que desde un punto de vista de políticas de ciencia, tecnología e innovación, sea conveniente impulsar, al mismo tiempo que los sistemas científicos en sentido estricto, los tecnológicos y los tecnocientíficos.

Pero subrayar el papel primordial de los valores epistémicos para evaluar las prácticas científicas y sus resultados, no quiere decir que los científicos, como agentes de los sistemas científicos, cuyo objetivo principal es la producción de conocimiento fiable, no deban rendir otras cuentas que sólo demostrar que generan conocimiento, ni que estén exentos de responsabilidades éticas y sociales. Por el contrario, la producción misma de conocimiento involucra responsabilidades éticas, y en virtud de la incorporación cada vez más intensa del conocimiento científico en los sistemas tecnológicos y tecnocientíficos, por medio de los cuales afectan a la sociedad y al ambiente, los científicos tienen responsabilidades ineludibles ante la sociedad, por ejemplo, dar opiniones bien fundadas sobre las ventajas y los riesgos de la aplicación de ciertos conocimientos, sobre las posibles soluciones de determinados problemas sociales y ambientales (muchas veces generados por las propias aplicaciones científico-tecnológicas), así como dejar claro dónde existen incertidumbres y en qué terrenos se carece aún de conocimientos bien fundados acerca de posibles consecuencias. También, en virtud de que los sistemas científicos son financiados por la sociedad, sea mediante recursos públicos -como lo es en México y en prácticamente toda América Latina- o privados, los científicos deben rendir cuentas del buen uso de esos recursos, y deben estar dispuestos a colaborar, como comunidad, en el desarrollo de los sistemas de innovación que permitan el aprovechamiento social de esos conocimientos. Pero esto no equivale a decir que cada científico, en lo individual, debe hacer él mismo la innovación. Fomentar una vinculación efectiva entre los sistemas científicos, los tecnológicos y los de innovación es responsabilidad de quienes diseñan y aplican políticas de ciencia, tecnología e innovación. Pero, insisto, esto no exime a los científicos de responsabilidades éticas y sociales (cf. Olivé, 2000 y 2007).

Las prácticas tecnológicas, a diferencia de las científicas, están orientadas principalmente no hacia la generación de conocimiento, sino a la transformación de objetos, que pueden ser materiales o simbólicos, aunque para ello usan conocimiento ya disponible y muchas veces generan nuevo conocimiento. No necesariamente buscan satisfacer un valor de mercado, como lo ilustran muchos de los desarrollos de software libre en nuestros días, pero es cierto que en las sociedades cuya economía se rige por el mercado, la tendencia dominante es que las prácticas tecnológicas generen productos con un valor de cambio que se realiza en el mercado.

Las prácticas tecnológicas incluyen conocimiento tácito, peculiar de cada una de ellas, pero además incorporan conocimientos que provienen en gran medida de prácticas distintas a ellas. Una de las características de las prácticas tecnológicas es que necesariamente deben utilizar conocimientos científicos (aunque no exclusivamente), los cuales se generan en los sistemas propiamente científicos.3

Éste es el panorama tradicional con respecto a la ciencia y la tecnología como las conocemos a partir de la revolución científica del siglo XVII y de la revolución industrial del XVIII. Hasta mediados del siglo XX, aproximadamente, la relación entre la ciencia, la tecnología y lo que ahora llamamos sistemas de innovación, se basaba en los elementos que burdamente hemos apuntado. Los sistemas de ciencia generaban conocimiento público, el cual muchas veces se incorporaba a sistemas tecnológicos que generaban artefactos. Por lo general, y cada vez de manera más intensa, el proceso de producción de esos artefactos (entendidos en un sentido amplio, no sólo como objetos materiales) era patentado con el fin de obtener beneficios económicos. Pero en las últimas décadas del siglo XX irrumpieron nuevas prácticas generadoras de conocimiento, que son también transformadoras de la realidad, las cuales producen resultados, materiales y simbólicos, y generan riqueza: las prácticas que muchos autores han llamado tecnocientíficas (cf. Echeverría, 2003). Antes de comentar sobre ellas, su estructura axiológica y los problemas éticos que plantean, revisemos brevemente la llamada tesis de la neutralidad ética de la ciencia y de la tecnología.

La ciencia y la tecnología, ¿son éticamente neutrales?

Esta tesis sostiene que el conocimiento científico no es bueno ni malo desde un punto de vista ético. El problema en todo caso, según esta tesis, puede surgir con sus aplicaciones. Pero esto ya no es un problema de la ciencia, ni de los científicos, sino de quienes aplican el conocimiento.

Para dirimir la controversia sobre la neutralidad ética de la ciencia es crucial la caracterización que se haga de la propia ciencia. Muchas veces se identifica a la ciencia sólo con el conocimiento científico, y entonces es sencillo concluir que la ciencia -reducida al conocimiento producido por ella- es éticamente neutral. Así, bajo esta perspectiva se omite la referencia a los métodos y los medios utilizados para obtener dicho conocimiento, y se deja de lado la responsabilidad ética de los científicos. Me referiré a dos casos que ilustran una y otra cuestión: el problema de los medios, y el de la responsabilidad de los científicos, qua científicos.

El primero es uno de los más citados en la historia de la ciencia donde se violaron las normas éticas más elementales: la investigación sobre la sífilis en Tuskegee, Alabama, donde, durante cuarenta años, entre 1932 y 1972, con el fin de obtener conocimiento científico acerca del desarrollo de la enfermedad en pacientes que no recibían tratamiento alguno, se hizo un seguimiento de alrededor de 400 sujetos, todos ellos negros, sin informarles que estaban enfermos de sífilis, haciéndoles creer que tenían otro padecimiento, sin ofrecerles ningún tratamiento -cuando el de la penicilina se hizo común a partir de 1943-, y evitando que recibieran ayuda por parte de alguna otra institución (véase, por ejemplo, http://www.cdc.gov/tuskegee/timeline.htm). El experimento sólo se detuvo cuando surgió un escándalo nacional a partir de una filtración de la información a la prensa. A partir de esta espeluznante investigación, hecha en nombre de la ciencia, para obtener conocimiento científico, en los Estados Unidos se redactó el llamado Informe Belmont, donde se establecieron principios éticos para proteger los derechos de las personas que participen en investigaciones de ese estilo (véase, http://ohsr.od.nih.gov/guidelines/belmont.html).

Este ejemplo muestra que es indispensable evaluar los medios que se utilizan, aunque el fin que se busque, y el resultado de hecho, sea genuino y puro conocimiento científico.

El segundo tipo de casos que quiero comentar es el de los problemas éticos que surgen de la relación entre los sistemas científico-tecnológicos y su entorno social y ambiental, y tiene que ver con consecuencias riesgosas de su operación. En este tipo de problemática pueden plantearse dilemas a los científicos, y de ahí la necesidad de establecer sistemas normativos que regulen la interacción de los sistemas científicos y técnicos con la sociedad.

Un caso paradigmático de un dilema ético se encuentra en la experiencia del Premio Nobel de Química 1995, Mario Molina, cuando a mediados de la década de 1970 consideró que tenía bases razonables para creer que los clorofluorocarbonos (CFC´s) eran los agentes causales del deterioro de la capa de ozono, pero no contaba en ese momento con evidencia que la comunidad científica pudiera considerar contundente.

Molina mismo ha narrado que enfrentó un dilema ético porque, por un lado, la metodología ortodoxa indicaba que el curso de acción correcto era proseguir las investigaciones hasta tener evidencia contundente que confirmara o refutara su hipótesis, y entretanto no parecía correcto alarmar a nadie fuera de la comunidad científica. Pero por otra parte, el daño que se estaba produciendo, de ser correcta la hipótesis y el que todavía vendría si no se tomaban medidas pertinentes en su momento, era tan grave, que parecía éticamente correcto iniciar de inmediato acciones para advertir a los productores de CFC´s, así como a la sociedad en general, que presumiblemente el daño era causado por ese compuesto químico producido industrialmente, por lo que era necesario iniciar acciones para disminuir su emisión a la atmósfera, antes de que la situación fuera más grave e incluso irreversible.

Molina y su colega Rowland optaron por el segundo cuerno del dilema, y con el tiempo se logró la evidencia suficiente que les concedió la razón. Sin embargo, si no se hubieran comenzado a tomar medidas antes de tener esa evidencia, es probable que se habría alcanzado un punto de no retorno. Esto significa que Molina, sin llamarle así en su momento, hizo una prudente aplicación de lo que ahora es ampliamente conocido como el principio de precaución.

Una formulación de dicho principio es la siguiente:

si existen bases razonables para sospechar que un producto causa daños al ambiente, el no haber alcanzado el grado de certeza exigido para aceptar una hipótesis como correcta, no es una razón suficiente para posponer políticas ambientales o de control de riesgos por parte de la sociedad, si el retraso en tomar medidas pudiera tener como consecuencia la existencia de daños muy serios y probablemente irreversibles.

Conviene subrayar que el dilema que se le planteó a Molina fue en su carácter de científico básico, en relación con un conocimiento científico, y no en relación con una posible intervención tecnológica o tecnocientífica de su parte, aunque el conocimiento que él generó sí se refería a consecuencias de acciones tecnológicas.

De este caso se pueden extraer las siguientes conclusiones:

- En ciertas circunstancias, saber (tener un determinado conocimiento) implica una responsabilidad moral.

- Es factible actuar de manera responsable en una situación en la que un sistema está produciendo daños, aun cuando no exista evidencia contundente para aceptar una relación causal entre la operación del sistema y los daños en cuestión.

- Es éticamente correcto aplicar el principio de precaución, a condición de que existan bases razonables para creer en la relación causal entre la operación de un sistema y determinado daño.

Los dos casos mencionados bastan para ilustrar la tesis de que la ciencia no es éticamente neutral, ni siquiera la ciencia básica en sentido tradicional.

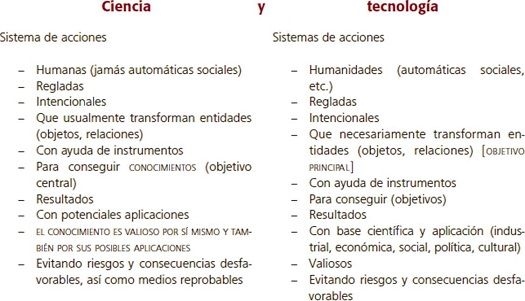

Dijimos antes que para dirimir la controversia sobre la neutralidad ética de la ciencia es crucial la caracterización que se haga de la propia ciencia. Bajo una concepción que ve a la ciencia y a la tecnología como sistemas de acciones humanas intencionales, desaparece toda duda sobre su neutralidad ética. Veamos cómo se pueden caracterizar desde este punto de vista.

Bajo esta concepción, la ciencia no se entiende únicamente como un conjunto de proposiciones o de teorías, ni la tecnología se entiende sólo como un conjunto de artefactos o de técnicas. La ciencia y la tecnología se entienden como constituidas por sistemas de acciones intencionales. Es decir, como sistemas que incluyen a los agentes que deliberadamente buscan ciertos fines, en función de determinados intereses, para lo cual ponen en juego creencias, conocimientos, valores y normas, y realizan acciones que de hecho producen resultados. Los intereses, las intenciones, los fines, los valores y las normas forman parte también de esos sistemas, y sí son susceptibles de una evaluación ética, lo mismo que los resultados que de hecho se producen y los medios utilizados para ello.

Así, los sistemas científicos y los técnicos pueden ser condenables o loables, según los fines que se pretendan lograr mediante su aplicación, los resultados que de hecho produzcan, los medios que utilicen, y el tratamiento que den a las personas como agentes morales. Vistas de esta manera, entonces, la ciencia y la tecnología no son éticamente neutrales (cf. Olivé, 2000).

La revolución tecnocientífica

Pero planteamos antes que en las últimas décadas del siglo XX irrumpieron nuevas prácticas de generación y aplicación de conocimiento, las tecnocientíficas, cuya importancia, en cuanto a los cambios en la formas de generar y usar el conocimiento, y con respecto a sus impactos sociales y ambientales, son tan intensos, que constituyen una auténtica revolución: la revolución tecnocientífica, de la cual la nanotecnología forma parte.

En efecto, como lo han sugerido ya muchos autores, lo novedoso en la segunda mitad del siglo XX fue el surgimiento de prácticas generadoras y transformadoras de conocimiento y de la realidad que no existían antes (Echeverría, 2003). En ellas se genera conocimiento, se transforma y, ahí mismo, en su seno, ese conocimiento se incorpora a otros productos, materiales o simbólicos, que tienen valor añadido por el hecho mismo de incorporar ese conocimiento. Dicho valor normalmente se debe a que los resultados de esas prácticas son útiles para mantener el poder económico, ideológico o militar (por ejemplo, técnicas de propaganda o de control de los medios de comunicación), o bien los resultados de esas prácticas tienen un valor que se realizará en el mercado.

El conocimiento y la técnica, en tanto que permiten transformar la realidad natural y social, han sido aprovechados por muchos grupos humanos para satisfacer sus necesidades, y también han sido puestos al servicio de quienes han detentado el poder político, económico y militar desde los principios de la humanidad. Eso no es ninguna novedad. Pero lo inédito es que las prácticas tecnocientíficas tienen una estructura distinta a las prácticas científicas y tecnológicas tradicionales, y varían también en su estructura axiológica, por lo que requieren de criterios de evaluación distintos a los usados para evaluar prácticas científicas y tecnológicas tradicionales. Esto tiene efectos importantes en las políticas de ciencia, tecnología e innovación.

Suele mencionarse al proyecto Manhattan (la construcción de la bomba atómica) como uno de los primeros grandes proyectos tecnocientíficos del siglo XX. Otros ejemplos paradigmáticos de tecnociencia hoy en día los encontramos en la investigación espacial, en la nuclear, en las redes satelitales y telemáticas, en la informática en general, en la biotecnología, en la genómica, en la proteómica, y ahora está moviéndose hacia el centro de gravedad la nanotecnología y los sistemas derivados de la convergencia bio-nano-cogno, que se refiere a la convergencia de las biotecnologías, con las nanociencias y las nanotecnologías, así como con las ciencias cognitivas y sus aplicaciones.

Los sistemas tecnocientíficos están conformados por grupos de científicos, de tecnólogos, de administradores y gestores, de empresarios e inversionistas y muchas veces de militares. Por esto, uno de los objetivos posibles que una red de nanociencia y nanotecnología podría plantearse en un país como México es la constitución de determinados sistemas tecnocientíficos, sistemas nanotecnocientíficos. Lo importante a discutir sería su estructura, quiénes participarían (individuos, instituciones, empresas, agencias locales, estatales y federales), cuáles serían sus fines, qué medios se utilizarían y, además de evaluar todo esto, habría que estar vigilantes de los riesgos que generan y de sus resultados de hecho, por razones que se explican adelante.

Cambios en la estructura axiológica de las prácticas epistémicas

Los sistemas científicos y tecnológicos tradicionales conviven ahora con los sistemas tecnocientíficos, los cuales reciben actualmente la mayor parte del financiamiento dedicado a ciencia y tecnología y son los que tienen mayores efectos sociales y ambientales.

Esto ha trastocado los sistemas de valores en la producción y circulación del conocimiento. Así, han aparecido prácticas epistémicas en cuya estructura axiológica se encuentran valores económicos como la ganancia financiera, o valores militares y políticos como la ventaja para vencer y dominar a otros, junto con valores que ahora son considerados positivos por algunos -si redundan en un beneficio económico- y que afectan directamente el dominio epistémico, tales como la apropiación privada del conocimiento y, por tanto, el secreto y a veces hasta el plagio. Valores todos incompatibles y de hecho inconcebibles para la ciencia que el mundo occidental conoció como la preponderante entre los siglos XVII y mediados del XX, cuya normatividad fue muy bien capturada en el “cudeo” mertoniano: comunismo, universalismo, desinterés y escepticismo organizado (Merton, 1942).4

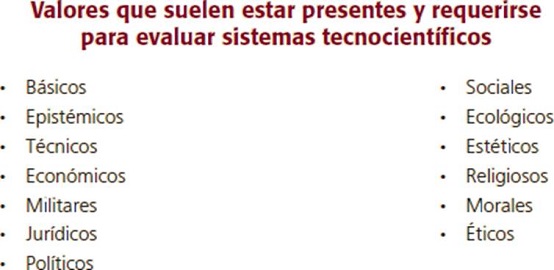

Javier Echeverría, en el libro antes mencionado (2003), ha propuesto que en las prácticas tecnocientíficas suelen estar involucrados doce tipos de valores (aunque no toda práctica tecnocientífica satisface necesariamente los doce), a los cuales nosotros agregamos uno más, los valores éticos, haciendo una distinción entre moral y ética.

Por moral entenderemos la moral positiva, es decir, el conjunto de normas y valores morales de hecho aceptados por una comunidad para regular las relaciones entre sus miembros. Por ética entenderemos el conjunto mínimo de valores y de normas racionalmente aceptados por comunidades con diferentes morales positivas, que les permiten una convivencia armoniosa y pacífica, y que incluso puede ser cooperativa. El respeto a la diferencia, así como la tolerancia horizontal, por ejemplo, son valores éticos fundamentales. Desde esta perspectiva, la ética tiene por tarea proponer valores y normas para la convivencia entre grupos con morales diferentes.

Esta tabla no debe entenderse como una “jerarquía de valores”. No es que haya unos más importantes que otros en términos generales o absolutos. La tabla describe los subsistemas de valores que suelen estar presentes en los sistemas tecnocientíficos y que son necesarios para evaluarlos. Una cuestión importante al analizar y evaluar un sistema tecnocientífico particular es identificar los valores incluidos en él, y determinar si algunos están subordinados a otros. Por ejemplo, en muchos sistemas tecnocientíficos actuales, los valores epistémicos y técnicos están subordinados a valores económicos como la ganancia. O, en el ejemplo del Proyecto Manhattan, claramente los valores dominantes eran los militares. Es decir, en estos casos, se satisfacen valores epistémicos y técnicos, pues de otro modo no se lograría el fin principal; sin embargo, en esos sistemas lo más importante es que se realicen los valores económicos o militares, y los epistémicos y técnicos se deben lograr, al menos hasta cierto punto, para que se satisfagan aquéllos. Pero puede ocurrir también que ciertos valores no estén incluidos en un sistema tecnocientífico determinado, por ejemplo, ecológicos, pero que sean necesarios para evaluarlo, digamos porque su operación tiene consecuencias negativas en el ambiente.

Problemas éticos de la tecnociencia

El anterior es el contexto dentro del cual conviene plantear las preguntas acerca de los problemas éticos de la tecnociencia. En lo que sigue nos concentraremos en dos cuestiones: 1) cuál es una forma éticamente correcta de enfrentar los riesgos que generan los sistemas tecnocientíficos, por ejemplo, posibles daños a la salud, a la sociedad y al ambiente y, 2) cuáles son las responsabilidades de los científicos y tecnólogos que participan en esos sistemas y qué responsabilidades tienen las instituciones y las empresas.

Para analizar este tipo de problemas conviene subrayar que los agentes intencionales que forman parte de los sistemas tecnocientíficos tienen la capacidad de construir representaciones de la realidad sobre la cual desean intervenir. También tienen la capacidad de abstraer de la realidad ciertos aspectos que les interesan, y de construir modelos y teorías para explicarse esos aspectos de la realidad y para poder intervenir sobre ellos, para modificarlos o para manipularlos en función de ciertos intereses. Los seres humanos también asignan valores a estados de cosas en el mundo. Por ejemplo, pueden considerarlos como deseables o indeseables. La evaluación de un objeto, de una situación o de las consecuencias de un proceso, necesariamente se hace desde un cierto punto de vista, en función de valores, de normas y de intereses específicos.

Pero los diferentes grupos humanos, por lo general, actúan conforme a distintos valores y normas, por lo que es frecuente que se realicen juicios encontrados. Por ejemplo, los materiales de construcción que se obtienen mediante la explotación de un bosque, digamos la madera, pueden ser valiosos para un grupo humano. Si además un grupo, una empresa, digamos, obtiene beneficios económicos de la explotación del bosque, también la juzgará valiosa. Pero si la explotación se realiza de forma irracional, de manera que se produce la deforestación de un valle, el proceso de tala puede ser juzgado indeseable por otros grupos. La sustitución de determinados cultivos con tecnologías tradicionales por otros con semillas modificadas genéticamente puede ser valiosa para ciertos sectores sociales, por ejemplo, por razones económicas, pero indeseable para otros grupos, digamos porque afecte de manera negativa e irreversible la riqueza de la biodiversidad o porque se trastornen prácticas culturales de alguna comunidad humana.

La confrontación de intereses y valores suele ser mucho más aguda en relación con la operación de los sistemas tecnocientíficos y en la evaluación de sus consecuencias. Un problema ético fundamental que se plantea en relación con la tecnociencia es el de si es posible lograr normas de convivencia armoniosa y de resolución pacífica de conflictos, dado que tales sistemas afectan a muy diversos grupos con intereses y valores diferentes. Veamos esto con respecto a los problemas de percepción y gestión del riesgo.

Tecnociencia y riesgo

Una de las características de los sistemas tecnocientíficos es que en virtud de su propia naturaleza producen en su entorno -social y ambiental- efectos a corto, mediano y largo plazo, muchos de los cuales son significativos para los seres humanos, y son imposibles de predecir en el momento de la puesta en funcionamiento del sistema (por ejemplo, la liberación al ambiente de un organismo genéticamente modificado, o la posibilidad de que nanoestructuras utilizadas para fines medicinales se alojen en determinados tejidos y afecten el funcionamiento de los órganos correspondientes). Esto significa que los sistemas tecnocientíficos generan situaciones de riesgo, de incertidumbre y muchas veces de ignorancia.

Una situación de riesgo es aquella en la que se pone en juego algo valioso para los seres humanos a partir de ciertas consecuencias posibles de la acción o de la operación de un cierto sistema, y pueden determinarse las probabilidades de que ocurra cada uno de los resultados. Una situación de riesgo es además de incertidumbre, si no hay manera de asignar las probabilidades con que pueden ocurrir sucesos que, sin embargo, se sabe que son posibles. Una situación es de ignorancia, si ni siquiera se conocen los sucesos posibles que pueden ocurrir como consecuencia de la aplicación de un sistema tecnocientífico.

El riesgo además tiene estas tres características:

- Un riesgo surge en situaciones de elección, a partir de decisiones humanas de actuar, producir y utilizar algo, o de omitir acciones y dejar que pase algo.

- Si se trata de daños que son el resultado de decisiones humanas, o por lo menos cuya ocurrencia ha sido posible en virtud de decisiones humanas, el riesgo lleva a la imputabilidad de alguna responsabilidad.

- El riesgo involucra problemas de justicia social, pues en las sociedades contemporáneas los conflictos sociales sobre riesgos involucran problemas respecto a la compensación por los daños y sobre el reparto de bienes (cf. López Cerezo y Luján, 2000).

La identificación, estimación, valoración, aceptabilidad y gestión del riesgo, necesariamente dependen de valores. Aunque no todos los valores involucrados son de tipo ético (Echeverría, 2002), existe un problema ético en las formas de enfrentar los problemas del riesgo que generan los sistemas tecnocientíficos, pues la información y el conocimiento pertinentes para la identificación, estimación y gestión del riesgo siempre dependen de un contexto, de la posición de quienes evalúan, de sus fines, intereses y valores. Por consiguiente, sus posiciones pueden ser muy diversas. El problema ético fundamental es cómo acordar cursos de acción sobre un conjunto de normas y valores aceptados por todos en común, aunque sus intereses sean distintos; es decir, normas y valores éticos para resolver problemas del manejo del riesgo.

La situación se complica más aún, pues es inherente a la naturaleza de los sistemas técnicos y su relación con el entorno, así como al conocimiento humano, que las consecuencias de sus aplicaciones no puedan delimitarse de una manera única, que sería la única correcta. La razón es que en el mundo en el que vivimos no existe -ni puede existir- unanimidad acerca de los valores, ni tampoco se comparte una misma visión sobre lo que es importante y lo que se debe hacer. Esto hace que en situaciones de riesgo las consecuencias serán juzgadas como favorables o desfavorables en función de los distintos sistemas de intereses y de valores. Las actuales controversias científicas y sociales sobre transgénicos claramente ilustran esto.

En materia de nano y nanobiotecnología existe un alto nivel de incertidumbre y de ignorancia generada de manera estructural por los sistemas que surgen y surgirán al insertarse los productos nano en la sociedad y en el ambiente. Por esto, deben preverse mecanismos sociales de evaluación y gestión del riesgo sobre cada sistema específico (evaluación caso por caso). Pero ante la diversidad de intereses y valores que necesariamente se enfrentarán, surge la necesidad de las normas éticas con base en las cuales deberían dirimirse las diferencias y llegar a acuerdos para gestionar los riesgos y, en su caso, tomar decisiones y realizar acciones que eviten o mitiguen daños.

En cuestiones de riesgo la situación también se complica porque las percepciones del riesgo están íntimamente ligadas a la forma como los seres humanos, desde diferentes posiciones, comprenden los posibles fenómenos que constituyen peligros o amenazas, y lo mismo ocurre con la evaluación de los daños, cuando llegan a suceder. De aquí se desprende que no hay una única comprensión correcta del riesgo, como tampoco hay una única y correcta manera de estimar el riesgo.

Por lo anterior, cuando se trata de evaluar los riesgos sociales y ambientales de la aplicación de sistemas tecnocientíficos, lo éticamente correcto es que participen representantes de diferentes grupos humanos con puntos de vista distintos y que pueden hacer diferentes aportaciones al problema. Por eso deben participar científicos naturales, científicos sociales, tecnólogos, humanistas, trabajadores de la comunicación, empresarios, políticos y los ciudadanos y todas las personas cuyas vidas pueden ser afectadas. Esto no significa desconocer que diferentes sectores de la sociedad, y diferentes miembros dentro de esos distintos sectores, los especialistas en diversas disciplinas, por ejemplo, tienen un acceso diferenciado a la información pertinente, al saber especializado, y a ciertos recursos necesarios para conocer y evaluar las consecuencias de un sistema tecnocientífico. Pero sí quiere decir que cuando se trata de evaluar resultados y decidir acciones en torno a esos sistemas que afectan a la sociedad o al ambiente, la visión y las conclusiones de cada sector serán necesariamente incompletas, y ninguno tiene un privilegio que justifique su participación a costa de excluir otros sectores que pueden aportar puntos de vista valiosos y pertinentes.

La identificación, evaluación y propuestas de gestión del riesgo depende de esos sistemas de valores, y puesto que no existe ningún sistema privilegiado por encima de los demás, entonces no hay una única manera correcta de identificar los riesgos, ni una única estimación acertada, ni una única valoración que sea la única justa. Por lo tanto, tampoco es posible una única visión sobre la gestión del riesgo que sea la única correcta y éticamente aceptable. En cuestión de identificación y evaluación de riesgos puede haber diferentes puntos de vista tan legítimos unos como otros. No se trata de una visión relativista que sostenga que cualquier punto de vista es tan bueno como cualquier otro. Se trata más bien de una concepción pluralista que sostiene que no existe un único punto de vista que sea el único correcto, y que por tanto, lo correcto desde un punto de vista ético es prever mecanismos de vigilancia y de toma de decisiones donde haya genuina representación de los diferentes puntos de vista involucrados.

La pluralidad exige que para encontrar una solución justa, la toma de decisiones resulte de un amplio proceso dialógico, donde se intercambie información, se propongan y se rebatan con razones los métodos a seguir y, finalmente, se ventilen abiertamente los intereses, fines y valores de todos los involucrados y afectados por los riesgos en cuestión y por las formas propuestas para evaluarlos y gestionarlos, para intentar atenuarlos o para compensar los daños, buscando alcanzar acuerdos aceptables para las diversas partes. Es decir, se requiere un conjunto de normas éticamente justificables, que animen y regulen la participación pública en el proceso de la identificación, la evaluación y la gestión del riesgo generado por los sistemas tecnocientíficos.

De lo anterior, podemos concluir que el principal desafío en materia de nanobioseguridad consiste en diseñar los mecanismos que aseguren la participación de expertos, de agentes económicos, de los diferentes sectores sociales y de ciudadanos afectados, en las discusiones y toma de decisiones. Así, la importancia de la nano-bioética consiste en gran medida en fortalecer las actitudes éticas y los mecanismos para dirimir conflictos con base en un conjunto mínimo de normas éticas de convivencia que sean resultado de acuerdos entre los grupos interesados.

Sin embargo, la construcción y operación efectiva de tales mecanismos sociales para la vigilancia del riesgo de la operación de sistemas nanotecnocientíficos, que permitan en su caso tomar decisiones éticamente correctas, es un problema social y sobre todo político, pues debe desprenderse de la toma de decisiones políticas en materia de seguridad, específicamente en este caso de nanobioseguridad.

El caso de Mario Molina que comentamos antes ofrece pistas para pensar en tales sistemas sociales de vigilancia de riesgos, pues implica formas de monitoreo sobre posibles efectos, al menos una vez que se reconoce que tales posibilidades existen, pero también estar pendientes del surgimiento de sucesos no previstos al diseñar y al iniciar la aplicación de un sistema tecnocientífico, así como su articulación con mecanismos sociales y políticos de toma de decisiones para actuar frente a los riesgos en caso de que se materialicen.

Conclusión: deberes de los científicos, los tecnólogos, los tecnocientíficos, de las instituciones, las empresas y de los ciudadanos

De lo propuesto hasta aquí se pueden concluir algunos deberes para los científicos, tecnólogos y tecnocientíficos, para las instituciones de investigación y de educación superior, para las empresas y organizaciones involucradas en los sistemas tecnocientíficos, así como para los ciudadanos.

Los científicos deben ser conscientes de las responsabilidades que adquieren en función de los temas que eligen para investigar, de las posibles consecuencias de su trabajo, y de los medios que escogen para obtener sus fines. En particular, deben estar conscientes de que su carácter de expertos los coloca en situaciones de responsabilidad, pues sobre determinados problemas en gran medida la sociedad depende de sus opiniones autorizadas.

Los tecnólogos y tecnocientíficos deben ser conscientes de la necesidad de evaluar los sistemas que diseñan y aplican, no sólo en términos de factibilidad, eficacia, eficiencia y fiabilidad, sino hasta donde sea posible en términos de las consecuencias en los sistemas naturales y sociales que serán impactados.

Como nunca se podrán conocer todas las consecuencias, los científicos y tecnólogos deben ser transparentes ante el público acerca de qué saben y qué no saben con respecto a sus posibles consecuencias. Pero, además, los científicos, tecnólogos y tecnocientíficos deben tener conciencia de la necesidad de evaluar los fines que se proponen alcanzar con un sistema tecnocientífico particular, y deben estar en condiciones de sostener racionalmente por qué es correcto obtener esos fines, así como por qué es válido usar los medios que utilizan.

Científicos, tecnólogos y tecnocientíficos deben tener claro que los fines que se persiguen suelen están ligados a estilos de vida específicos y pueden modificar muchas formas de vida socialmente significativas. Por eso, también los científicos, los tecnólogos y los tecnocientíficos deberían estar en condiciones de explicar por qué es lícito desear los estilos de vida que van asociados con los fines que se proponen y con los resultados de las aplicaciones de sus logros.

Pero éstas son discusiones humanísticas y para enfrentarlas adecuadamente se requiere hacerlas conjuntamente mediante equipos interdisciplinarios con representantes de las ciencias naturales, las tecnologías, las humanidades y las ciencias sociales.

De aquí se desprende una obligación para las instituciones educativas encargadas de la formación de científicos, tecnólogos y tecnocientíficos: es necesario reforzar una formación que promueva la participación conjunta en equipos que aborden, por ejemplo, los problemas éticos que plantea el diseño y la operación de sistemas tecnocientíficos específicos.

Los ciudadanos en general también tienen responsabilidades en la evaluación de los sistemas tecnológicos, en su aceptación y propagación, especialmente por el tipo de consecuencias sociales y ambientales. Por eso tienen el deber de informarse adecuadamente sobre la naturaleza de tales sistemas, acerca de qué se sabe y qué no con respecto a las consecuencias de medidas tecnocientíficas, y participar en las controversias que permiten establecer acuerdos entre diferentes grupos de interés para tomar decisiones que afectan a grupos o a sociedades enteras.

Las instituciones encargadas de la investigación y educación científico-tecnológica, así como las empresas que desarrollan y aplican los sistemas tecnocientíficos, tienen el deber de difundir una imagen accesible y fidedigna de la ciencia, de la tecnología y de la tecnociencia, así como de resultados específicos que se esperan de sistemas tecnocientíficos particulares, de los riesgos previstos, de lo que hasta el momento se sabe de manera confiable con respecto a los posibles impactos, y de las formas en que pueden vigilarse.

Los humanistas y científicos sociales también deben nutrirse de esta información, para ser capaces de participar en los grupos inter y transdisciplinarios que, en general, ofrezcan reflexiones sobre la importancia y el valor humanístico, social y cultural de la ciencia, de la tecnología y de la tecnociencia, de sus ventajas y de sus riesgos, así como evaluaciones específicas de sistemas tecnocientíficos particulares.

La manera ética y políticamente más aceptable de enfrentar los desafíos en materia de nano-bioseguridad es establecer los mecanismos que aseguren la amplia participación de expertos de todas las disciplinas científicas (incluyendo las sociales), tecnológicas y humanísiticas, de los diferentes sectores sociales interesados y de ciudadanos afectados, en las discusiones y toma de decisiones sobre la amplia variedad de problemas que habrán de suscitarse en el futuro y que nadie tiene la posibilidad de prever hoy.

Bibliografía

- Echeverría, Javier. (2002). Ciencia y valores, Barcelona: Destino.

- ______ (2003). La revolución tecnocientífica, Madrid: FCE.

- López Cerezo, José A. y José Luis Luján. (2000). Ciencia y política del riesgo, Madrid: Alianza Editorial.

- Merton, Robert K. (1942). “The normative structure of science” (publicado originalmente como “Science and technology in a democratic order”). The Sociology of Science, Chicago: Chicago University Press, 1973: 267-278.

- Olivé, León. (2000). El bien, el mal y la razón. Facetas de la ciencia y la tecnología, México: Paidós.

- ______.(2007). La ciencia y la tecnología en la sociedad del conocimiento. Ética, política y epistemología, México: FCE.

- Quintanilla, Miguel Ángel. (2005). Tecnología: un enfoque filosófico y otros ensayos de filosofía de la tecnología, México: FCE.

Notas

1 Adelante discutiremos brevemente la tesis de la “neutralidad ética de la ciencia”. Veremos que esta tesis depende de una concepción de la ciencia que puede ser fuertemente criticada.

2 Explicaremos más adelante la diferencia entre prácticas científicas, tecnológicas y tecnocientíficas.

3 Distinguimos entre prácticas técnicas y tecnológicas. Las segundas son aquéllas cuyo objetivo central es la transformación de objetos mediante procedimientos que se benefician del conocimiento científico. Las prácticas técnicas, en general, son las que transforman objetos sin hacer uso necesariamente de conocimiento científico. Toda práctica tecnológica es técnica, pero no a la inversa (cf. Quintanilla, 2005).

4 El universalismo debe entenderse como opuesto al personalismo. Las verdades científicas deben someterse a criterios impersonales, coherentes con los conocimientos previamente establecidos. El comunismo significa propiedad común de los bienes, en este caso del conocimiento científico. Los hallazgos de la ciencia son producto de la colaboración social que deben ser atribuidos y ser propiedad de la comunidad. El escepticismo organizado se refiere a la suspensión temporal del juicio y al escrutinio no comprometido de las creencias sobre criterios empíricos y lógicos. El desinterés es un elemento institucional básico, que no debe confundirse con motivos personales de los científicos. Entre las motivaciones se encuentran la pasión por el conocimiento, la curiosidad ociosa, las preocupaciones altruistas por el bien de la humanidad, pero el desinterés no debe entenderse como una motivación, sino como una característica de la institución de la ciencia, que tiene su origen en los imperativos epistemológicos y metodológicos de la producción y validación del conocimiento científico.